原文地址:https://www.cnblogs.com/zys2019/p/14816634.html

一、概述

1.1 定义

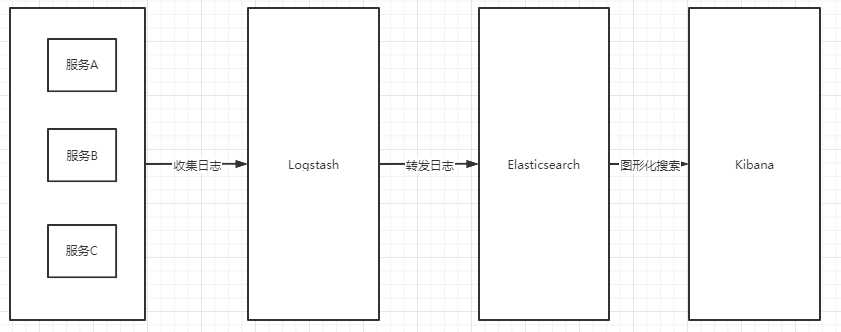

对于大规模的日志,需要集中化的管理。而ELK提供了一整套解决方案,并且都是开源软件,之间互相配合使用,完美衔接,高效的满足了很多场合的应用。ELK是三种技术产品的简称,包括Elasticsearch、Logstash、Kibana,可在项目中作为日志框架使用。

1.2 功能说明

- Elasticsearch是个开源分布式搜索引擎,提供搜集、分析、存储数据三大功能。

- Logstash 主要是用来日志的搜集、分析、过滤日志的工具,支持大量的数据获取方式。

- Kibana 也是一个开源和免费的工具,Kibana可以为 Logstash 和 ElasticSearch 提供的日志分析友好的 Web 界面,可以帮助汇总、分析和搜索重要数据日志。

简单来说,应用服务生产日志,通过Logger产生日志并输出;Logstash通过http接收应用服务产生的日志;Elasticsearch为日志提供全文检索功能;kibana为Elasticsearch提供图形化界面。

二、部署ELK

部署环境

- CentOS Linux release 7.9.2009 (Core)

- Docker Version: 20.10.12

- Docker Compose version v2.3.4

2.1 创建目录及配置文件

1) 创建elasticsearch数据目录及插件目录

mkdir -p /home/middleware/elk/elasticsearch/data

mkdir -p /home/middleware/elk/elasticsearch/plugins

//elasticsearch数据文件夹授权,保障docker容器中读写权限

chmod 777 /home/middleware/elk/elasticsearch/data

2) 创建kibana目录,以便后续汉化操作

mkdir -p /home/middleware/elk/kibana/config

touch /home/middleware/elk/kibana/config/kibana.yml

配置kibana汉化

vim /home/middleware/elk/kibana/config/kibana.yml

#

# ** THIS IS AN AUTO-GENERATED FILE **

#

# Default Kibana configuration for docker target

server.host: "0.0.0.0"

server.shutdownTimeout: "5s"

# 注意你的本地IP

elasticsearch.hosts: [ "http://本地IP:9200" ]

monitoring.ui.container.elasticsearch.enabled: true

#汉化

i18n.locale: "zh-CN"

3) 创建logstash.conf配置文件

mkdir -p /home/middleware/elk/logstash.conf配置文件/conf.d/

touch /home/middleware/elk/logstash/conf.d/logstash.conf

编辑配置logstash.conf,其内容如下

vim /home/middleware/elk/logstash/conf.d/logstash.conf

input {

tcp {

mode => "server"

host => "0.0.0.0"

port => 4560

codec => json

}

}

output {

elasticsearch {

hosts => "es:9200"

index => "logstash-%{+YYYY.MM.dd}"

}

}

在这里指定了输入的日志的端口是4560,那么下面对外暴露的端口也必须是4560。

4) 创建docker-compose.yml文件

touch /home/middleware/elk/docker-compose.yml

2.2 配置docker-compose并启动

cd /home/middleware/elk

vim docker-compose.yml

配置内容如下:

version: '3.7'

services:

elasticsearch:

image: elasticsearch:7.17.1

container_name: elasticsearch

privileged: true

user: root

environment:

#设置集群名称为elasticsearch

- cluster.name=elasticsearch

#以单一节点模式启动

- discovery.type=single-node

#设置使用jvm内存大小

- ES_JAVA_OPTS=-Xms512m -Xmx512m

volumes:

- /home/middleware/elk/elasticsearch/plugins:/usr/share/elasticsearch/plugins

- /home/middleware/elk/elasticsearch/data:/usr/share/elasticsearch/data

ports:

- 9200:9200

- 9300:9300

logstash:

image: logstash:7.17.1

container_name: logstash

ports:

- 4560:4560

privileged: true

environment:

- TZ=Asia/Shanghai

volumes:

#挂载logstash的配置文件

- /home/middleware/elk/logstash/conf.d/logstash.conf:/usr/share/logstash/pipeline/logstash.conf

depends_on:

- elasticsearch

links:

#可以用es这个域名访问elasticsearch服务

- elasticsearch:es

kibana:

image: kibana:7.17.1

container_name: kibana

ports:

- 5601:5601

privileged: true

links:

#可以用es这个域名访问elasticsearch服务

- elasticsearch:es

depends_on:

- elasticsearch

environment:

#设置访问elasticsearch的地址

- elasticsearch.hosts=http://elasticsearch:9200

volumes:

- /home/middleware/elk/kibana/config/kibana.yml:/usr/share/kibana/config/kibana.yml

这里使用privileged设置为true是赋予这个容器root权限。然后启动

5) docker-compose启动elk

完整目录结构如下图

cd /home/middleware/elk

docker-compose up -d

若启动报错,需要先关闭并删除容器后再重新启动。关闭删除命令:

docker-compose down

2.3 打开kibana

输入http://192.168.1.104:5601/app/home,访问Kibana web界面。点击左侧设置,进入Management界面

三、日志收集

本文通过SpringBoot架构把日志信息记录到logstash。

3.1 环境准备

- IntelliJ IDEA 2019.3.5

- Spring-boot

3.1.1 创建springboot项目

1) 打开IDEA,新建File -> New -> Project -> Spring Initializr

2) 创建springelk测试项目

3) 新建一个springboot的项目,在 pom.xml 下导入以下web的依赖

<!--集成logstash开始-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency>

<groupId>net.logstash.logback</groupId>

<artifactId>logstash-logback-encoder</artifactId>

<version>6.6</version>

</dependency>

<!--集成logstash结束-->

3.1.2 使用logback记录日志

logback是SpringBoot自带的日志,只要导入了web的依赖即可使用。

1) 在测试包下新建一个测试类和测试方法

import org.apache.logging.log4j.LogManager;

import org.apache.logging.log4j.Logger;

import org.junit.Test;

import org.junit.runner.RunWith;

import org.springframework.boot.test.context.SpringBootTest;

import org.springframework.test.context.junit4.SpringRunner;

/**

*

* @author lkh

* date:2022-03-30

*/

@RunWith(SpringRunner.class)

@SpringBootTest(classes = SpringElkTest.class)

public class SpringElkTest {

//创建log对象

Logger logger = LogManager.getLogger(this.getClass());

@Test

public void logback() {

logger.info("这是一个logback日志Info信息");

logger.error("这是一个logback日志Error信息");

}

}

2)在resources目录新建logback-spring.xml

写入以下内容

<?xml version="1.0" encoding="UTF-8"?>

<!DOCTYPE configuration>

<configuration>

<include resource="org/springframework/boot/logging/logback/defaults.xml"/>

<include resource="org/springframework/boot/logging/logback/console-appender.xml"/>

<!--应用名称-->

<property name="APP_NAME" value="springboot-logback-elk-demo"/>

<!--日志文件保存路径-->

<property name="LOG_FILE_PATH" value="{LOG_FILE:-{LOG_PATH:-{LOG_TEMP:-{java.io.tmpdir:-/tmp}}}/logs}"/>

<contextName>{APP_NAME}</contextName>

<!--每天记录日志到文件appender-->

<appender name="FILE" class="ch.qos.logback.core.rolling.RollingFileAppender">

<rollingPolicy class="ch.qos.logback.core.rolling.TimeBasedRollingPolicy">

<fileNamePattern>{LOG_FILE_PATH}/{APP_NAME}-%d{yyyy-MM-dd}.log</fileNamePattern>

<maxHistory>30</maxHistory>

</rollingPolicy>

<encoder>

<pattern>{FILE_LOG_PATTERN}</pattern>

</encoder>

</appender>

<!--输出到logstash的appender-->

<appender name="LOGSTASH" class="net.logstash.logback.appender.LogstashTcpSocketAppender">

<!--可以访问的logstash日志收集端口-->

<destination>192.168.1.104:4560</destination>

<encoder charset="UTF-8" class="net.logstash.logback.encoder.LogstashEncoder"/>

</appender>

<root level="INFO">

<appender-ref ref="CONSOLE"/>

<appender-ref ref="FILE"/>

<appender-ref ref="LOGSTASH"/>

</root>

</configuration>

3) 然后启动测试方法,查看控制台日志。

4) 返回kibana页面,创建索引,已自动搜索展示出来

5) 选择Discover,可以看到刚才打印的日志已经反馈到kibana中

查看信息时,建议在左侧Available fields中筛选出"message"信息,"host"字段可选。筛选的字段在左侧也可以看到,右侧看到的信息就比较清晰。

需要注意的是,在这些日志中,时间是logstash收集日志时的创建时间,并不是原始日志的记录时间。

3.1.3 使用log4j2记录日志

要使用log4j2,则必须排除SpringBoot自带的日志。

1) pom.xml中排除logback并导入log4j2依赖

<!--集成log4j2开始-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter</artifactId>

<exclusions>

<!-- 引入log4j日志时需去掉默认的logback -->

<exclusion>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-logging</artifactId>

</exclusion>

</exclusions>

</dependency>

<!-- 日志管理log4j2 -->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-log4j2</artifactId>

<version>2.1.0.RELEASE</version>

</dependency>

<!--集成log4j2结束 -->

在资源目录下新建log4j2.xml

<?xml version="1.0" encoding="UTF-8"?>

<configuration status="info">

<Properties>

<!-- 声明日志文件存储的目录 -->

<Property name="LOG_HOME">E:\logs</Property>

<Property name="LOG_PATTERN"

value="%date{yyyy-MM-dd HH:mm:ss.SSS} %-5level [%thread][%class{36}:%line] - %msg%n"></Property>

</Properties>

<Appenders>

<!--输出控制台的配置-->

<Console name="Console" target="SYSTEM_OUT">

<!--控制台只输出level及以上级别的信息(onMatch),其他的直接拒绝(onMismatch)-->

<ThresholdFilter level="info" onMatch="ACCEPT" onMismatch="DENY"/>

<!-- 输出日志的格式-->

<PatternLayout pattern="{LOG_PATTERN}"/>

</Console>

<!--这输出日志到文件的配置,每次大小超过size,则这size大小的日志会自动存入按年份-月份建立的文件夹下面并进行压缩,作为存档-->

<RollingFile name="RollingFile" fileName="{LOG_HOME}\app_{date:yyyy-MM-dd}.log"

filePattern="{LOG_HOME}\{date:yyyy-MM}\app_%d{yyyy-MM-dd}_%i.log">

<ThresholdFilter level="info" onMatch="ACCEPT" onMismatch="DENY"/>

<!-- 输出日志的格式-->

<PatternLayout pattern="{LOG_PATTERN}"/>

<!-- 日志文件大小 -->

<SizeBasedTriggeringPolicy size="20MB"/>

<!-- 最多保留文件数 -->

<DefaultRolloverStrategy max="30"/>

</RollingFile>

<!--输出到logstash的appender-->

<Socket name="Socket" host="192.168.1.104" port="4560" protocol="TCP">

<!--输出到logstash的日志格式-->

<PatternLayout pattern="${LOG_PATTERN}"/>

</Socket>

</Appenders>

<!--然后定义Logger,只有定义了Logger并引入的Appender,Appender才会生效。Root中level配置了日志级别,可配置其他级别-->

<Loggers>

<Root level="info">

<AppenderRef ref="Console"/>

<AppenderRef ref="RollingFile"/>

<AppenderRef ref="Socket"/>

</Root>

</Loggers>

</configuration>

注意需要指定logstash服务的ip和记录日志的端口。

3) 新建测试类及方法

import org.apache.logging.log4j.LogManager;

import org.apache.logging.log4j.Logger;

import org.junit.Test;

import org.junit.runner.RunWith;

import org.springframework.boot.test.context.SpringBootTest;

import org.springframework.test.context.junit4.SpringRunner;

/**

*

* @author lkh

* date:2022-03-30

*/

@RunWith(SpringRunner.class)

@SpringBootTest(classes = SpringElkTest.class)

public class SpringElkTest {

//创建log对象

Logger logger = LogManager.getLogger(this.getClass());

/*@Test

public void logback() {

logger.info("这是一个logback日志Info信息test1111");

logger.error("这是一个logback日志Error信息test1111");

}*/

@Test

public void log4j2() {

logger.info("这是一个log4j2日志Info信息");

logger.error("这是一个log4j2日志Error信息");

}

}

4) 启动测试方法

查看kibana的日志信息

查看信息时,建议在左侧Available fields中筛选出"message"信息,"thread_name","host"字段可选。筛选的字段在左侧也可以看到,右侧看到的信息就比较清晰,包含了日志本身的时间,这是是配置日志配置的。